【标题】Constrained Text Generation with Global Guidance -- Case Study on CommonGen

【作者团队】Yixian Liu, Liwen Zhang, Wenjuan Han, Yue Zhang, Kewei Tu

【研究团队】 腾讯互动娱乐事业群 & 西湖大学 & 上海科技大学 & 南洋理工大学

【论文链接】https://arxiv.org/pdf/2103.07170.pdf

【发表时间】2021.3.12

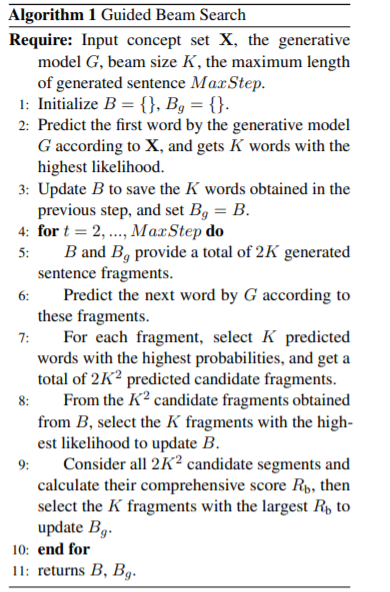

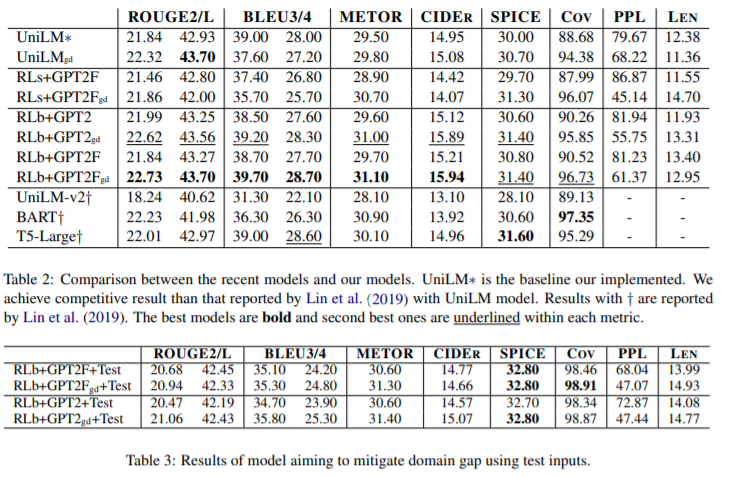

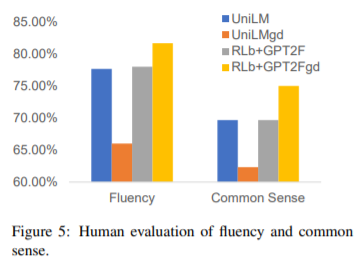

【推荐理由】本文研究了约束文本生成,即在一定的前提条件下生成句子。将基于一组概念生成文本的任务CommonGen,作为约束文本生成的典型案例。传统方法主要依靠有监督的训练来最大化目标句的可能性。然而,诸如常识和覆盖范围之类的全局约束不能被纳入自回归解码过程的似然性目标中。本文考虑使用强化学习来解决这一局限性,用综合得分来衡量全局约束,包括流畅性、常识和概念覆盖,作为对强化学习的奖励。此外,还在词、片段和句子三个层面设计了一种引导解码方法。实验结果表明,与基线模型相比,该方法显著提高了概念覆盖率,并在总体上提高了各种自动评价和人工评价的得分。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢