【论文标题】 Dependent Multi-Task Learning with Causal Intervention for Image Captioning

【作者团队】Wenqing Chen,Jidong Tian,Caoyun Fan,Hao He,Yaohui Jin

【机构】上海交通大学

【论文链接】https://arxiv.org/pdf/2105.08573.pdf

【推荐理由】

本文来自上海交通大学,已被IJICAI2021接收。文章提出了一个新颖的基于因果干预的多任务学习框架用于图像字幕任务。

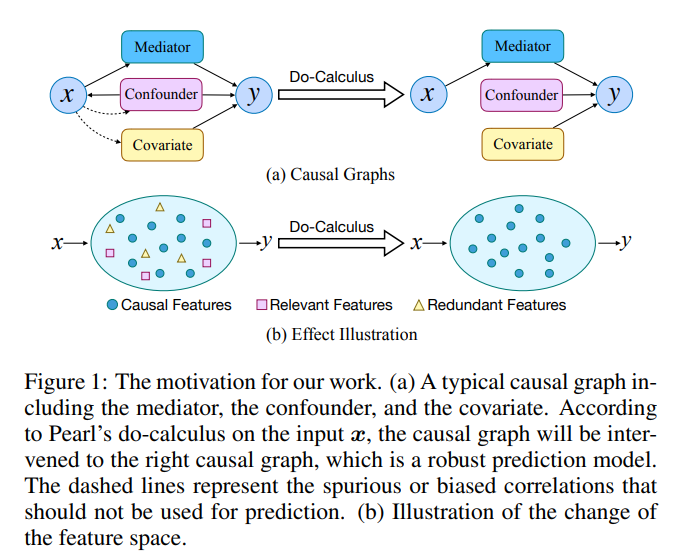

最近的图像字幕工作主要遵循先提取后生成的模式,先提取一系列基于对象的特征,然后将图像字幕描述为一个序列到序列的任务。虽然前景看好,但我们观察到在生成字幕时存在两个问题:1)内容不一致,模型会生成相互矛盾的事实;2) 信息量不够,模型会遗漏部分重要信息。从因果关系的角度来看,原因是模型捕捉到了视觉特征和某些表情(例如,“长头发”和“女人”的视觉特征)之间虚假的统计相关性。在本文中,我们提出了一个基于因果干预的依赖多任务学习框架(DMTCI)。首先,我们涉及到一个中间任务,类别包生成,最后一个任务之前,图像字幕。中间任务可以帮助模型更好地理解视觉特征,从而缓解内容不一致的问题。其次,我们在模型上应用Pearl的do演算,切断视觉特征和可能的混淆因素之间的联系,从而使模型聚焦于因果视觉特征。具体地说,高频概念集被认为是代理混杂因子,其中真实混杂因子是在连续空间中推断出来的。最后,我们使用多智能体强化学习(MARL)策略来进行端到端训练,减少任务间错误的累积。大量的实验表明,我们的模型优于基准模型,并取得了与最先进的模型竞争的性能。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢