论文标题“:Towards Compact Single Image Super-Resolution via Contrastive Self-distillation

论文链接:https://arxiv.org/abs/2105.11683

代码链接:https://github.com/Booooooooooo/CSD

作者单位:华东师范大学 & 厦门大学 & 新加坡国立大学

本文提出了一种新颖的对比自蒸馏(CSD)框架,以同时压缩和加速各种现成的SR模型!如压缩和加速EDSR,RCAN和CARN等SR模型,代码刚刚开源!

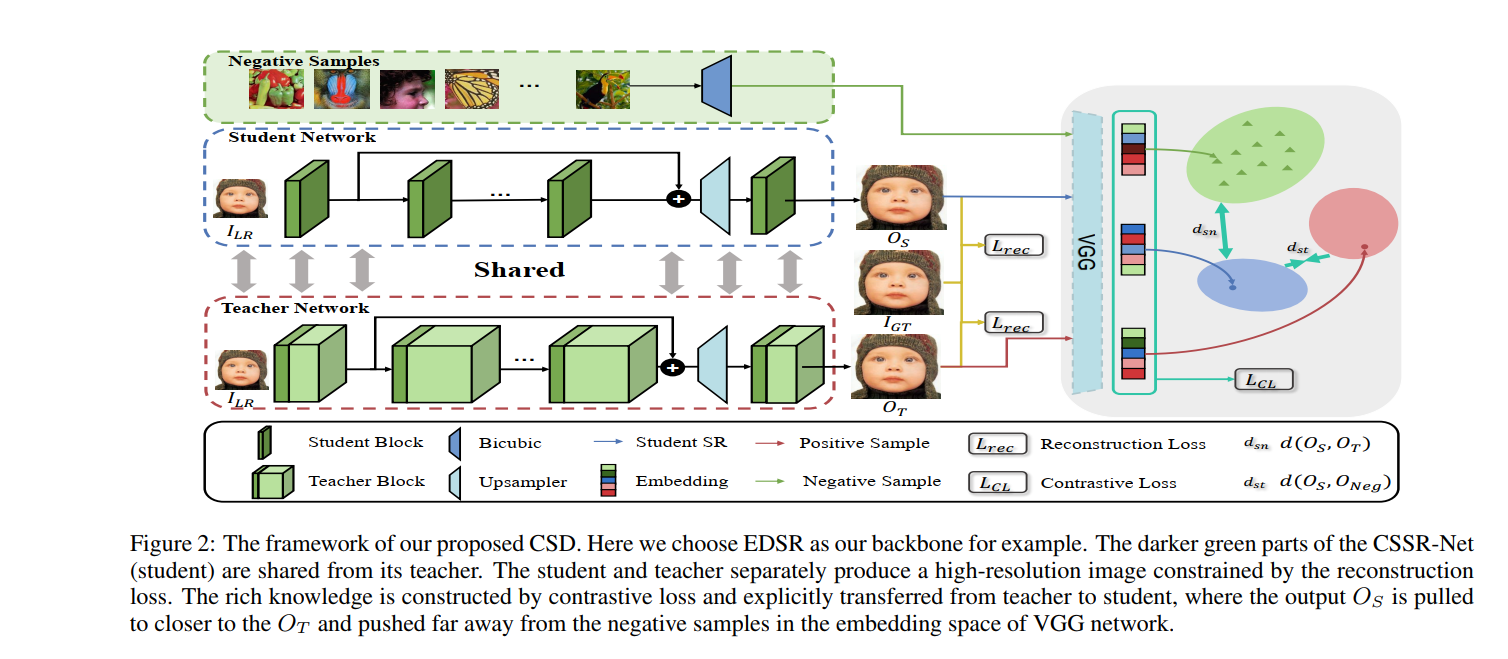

卷积神经网络(CNN)在超分辨率(SR)方面非常成功,但通常需要具有大量的内存成本和计算开销的复杂体系结构,从而极大地限制了它们在资源受限设备上的实际部署。在本文中,我们提出了一种新颖的对比自蒸馏(CSD)框架,以同时压缩和加速各种现成的SR模型。尤其是,可以首先从目标教师网络构建一个紧凑的学生网络作为通道拆分超分辨率网络。 然后,我们提出了一种新颖的对比损失,通过显式知识迁移来提高SR图像和PSNR / SSIM的质量。 大量实验表明,提出的CSD方案有效压缩和加速了几种标准SR模型,例如EDSR,RCAN和CARN。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢