论文标题:Revisiting Knowledge Distillation for Object Detection

论文链接:https://arxiv.org/abs/2105.10633

作者单位:华为

本文提出一种新的目标检测知识蒸馏方法。

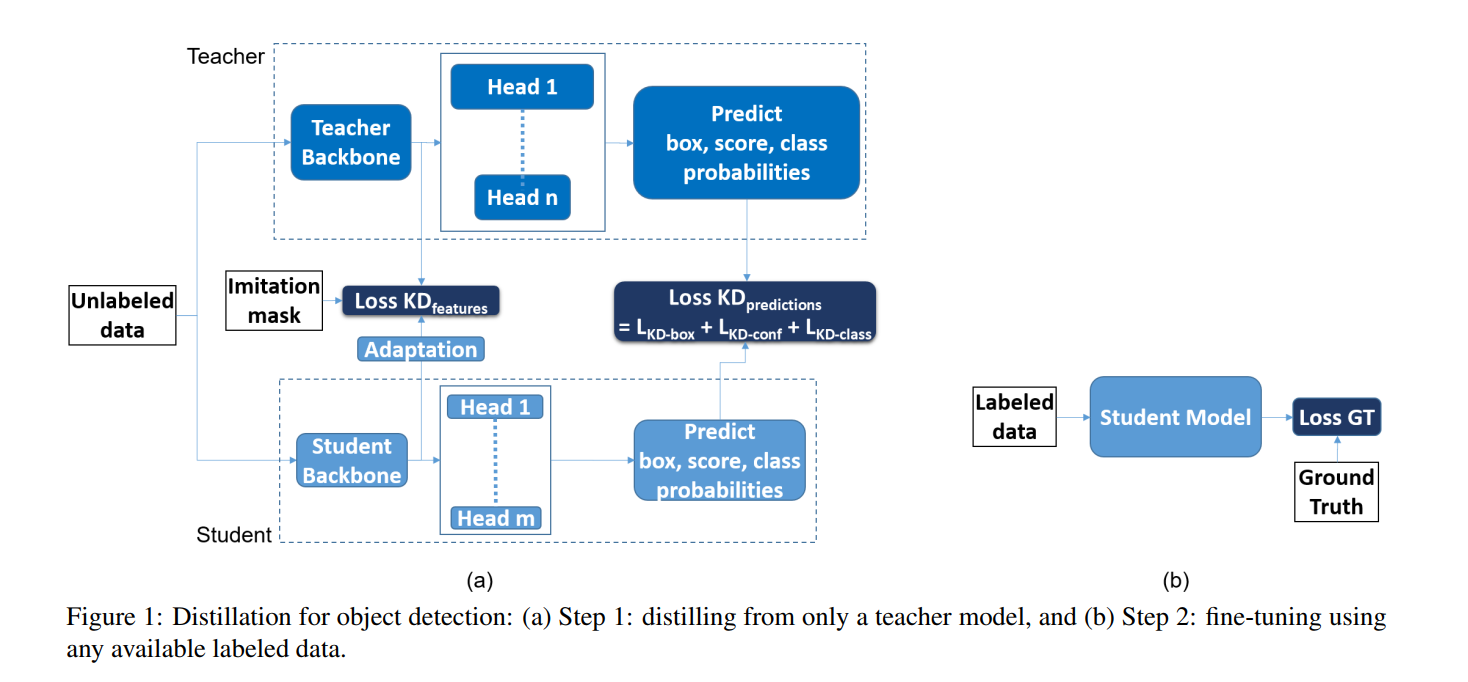

现有的目标检测蒸馏解决方案依赖于教师模型和真实标签的可用性。我们提出了一个新的视角来解决这种限制。在我们的框架中,学生首先使用教师生成的伪标签进行训练,然后使用标记数据进行微调(如果有)。大量实验证明了对现有目标检测蒸馏算法的改进。此外,在这个框架中将教师和真实数据蒸馏解耦提供了有趣的特性,例如:1) 使用未标记的数据进一步提高学生的表现,2) 结合不同架构的多个教师模型,甚至具有不同的对象类别,以及 3 ) 减少对标记数据的需求(只有 20% 的 COCO 标签,该方法实现了与在整个标签集上训练的模型相同的性能)。此外,这种方法的一个by-product是域适应的潜在用途。我们通过广泛的实验验证了这些特性。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢