论文标题:StyTr^2: Unbiased Image Style Transfer with Transformers

论文链接:https://arxiv.org/abs/2105.14576

作者单位:中国科学院大学

据作者称,这是第一个基于Transformer的风格迁移网络,并提出专用的内容感知位置编码机制(CAPE),表现SOTA!性能优于ArtFlow、MCC和AdaIN等网络。

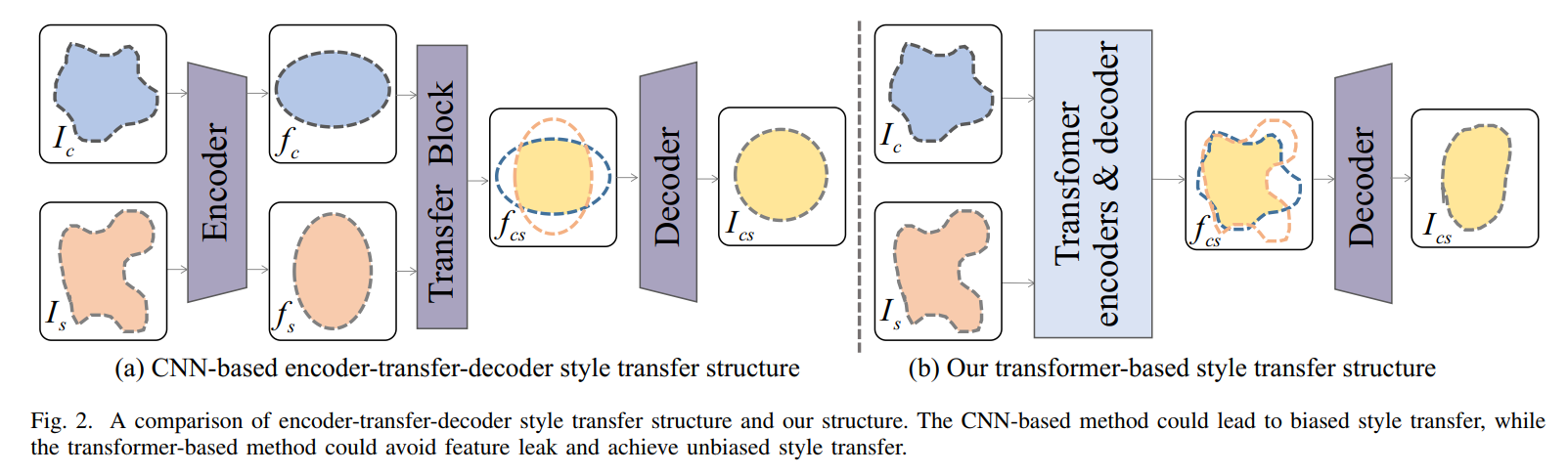

图像风格迁移的目标是在保持原始内容的同时,通过风格参考来渲染具有艺术特征的图像。由于 CNN 的局部性和空间不变性,很难提取和维护输入图像的全局信息。因此,传统的神经风格迁移方法通常是有偏差的,通过使用相同的参考风格图像运行多次风格迁移过程可以观察到content leak。为了解决这个关键问题,我们通过提出一种基于Transformer的方法,即 StyTr^2,将输入图像的long-range依赖性考虑到无偏风格转移。与用于其他视觉任务的视觉Transformer相比,我们的 StyTr^2 包含两个不同的Transfomrer编码器,分别为内容和风格生成特定于域的序列。在编码器之后,采用多层Transformer解码器根据样式序列对内容序列进行风格化。此外,我们分析了现有位置编码方法的不足,提出了尺度不变且更适合图像风格迁移任务的内容感知位置编码(CAPE)。与最先进的基于 CNN 和基于flow的方法相比,定性和定量实验证明了所提出的 StyTr^2 的有效性。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢