【论文标题】Human-centric Relation Segmentation: Dataset and Solution

【作者团队】Shaohua Li, Xiuchao Sui, Xiangde Luo, Xinxing Xu, Yong Liu, Rick Siow Mong Goh

【发表时间】2021/05/20

【机构】北京航空航天大学、中科院、Sea AI Lab

【论文链接】https://arxiv.org/pdf/2105.11168.pdf

本文出自北京航空航天大学、中科院、Sea AI Lab 联合团队,已被 TPAMI 接收。在本文中,作者提出了一种细粒度的视觉关系检测问题,旨在预测人类与周围物体的关系,并识别与关系相关的人体部位。作者发布了用于该任务的数据集 PIC,并提出了相应的解决方案对比基线。

近年来,视觉和语言理解技术取得了显著进步,但目前的技术仍然难以很好地处理涉及非常细粒度的细节问题。例如,当机器人被告知「把女孩左手的书拿给我」时,如果女孩的左手和右手各拿着一本书,则大多数现有的方法将失效。

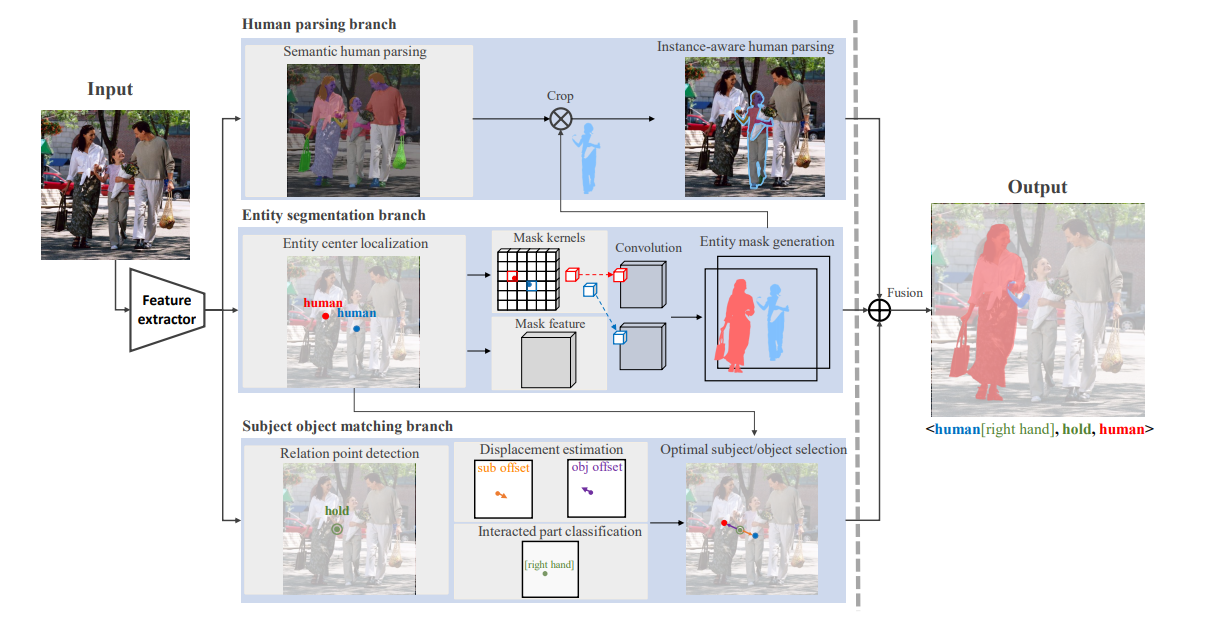

在本文中,作者引入了一种名为「以人为中心的关系分割」(HRS)的新任务,该任务可以被视为人物交互检测的细粒度版本。 HRS 旨在预测人类与周围实体之间的关系并识别与关系相关的人体部位,我们将这些部位表示为像素级掩码。对于上述示例,HRS 任务产生的输出为关系三元组 <girl [left hand], hold, book> 的形式,并给出精确分割出来的书本掩码,机器人可以轻松完成抓取任务。

本文作者为这项新任务收集了一个新的数据集——Person In Context (PIC) ,该数据集包含 17,122 张高分辨率图像和密集注释的实体分割和关系,包括 141 个对象类别、23 个关系类别和 25 个语义人体部位。

本文作者还提出了同时进行匹配和分割 (SMS) 的框架,该框架可以作为 HRS 任务的解决方案。 它将实体分割、主语宾语匹配、人物解析三个分支的输出融合,从而以产生最终的 HRS 结果。

图 1:SMS 框架示意图

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢