论文标题:FoveaTer: Foveated Transformer for Image Classification

论文链接:https://arxiv.org/abs/2105.14173

作者单位:加州大学圣巴巴拉分校

本文提供了一个综合框架,用于在视觉Transformer上使用foveal(视网膜中央凹)来完成图像分类任务。类似于DeiT模型对知识迁移的依赖,本文模型依赖于模型集成来达到最先进的性能。

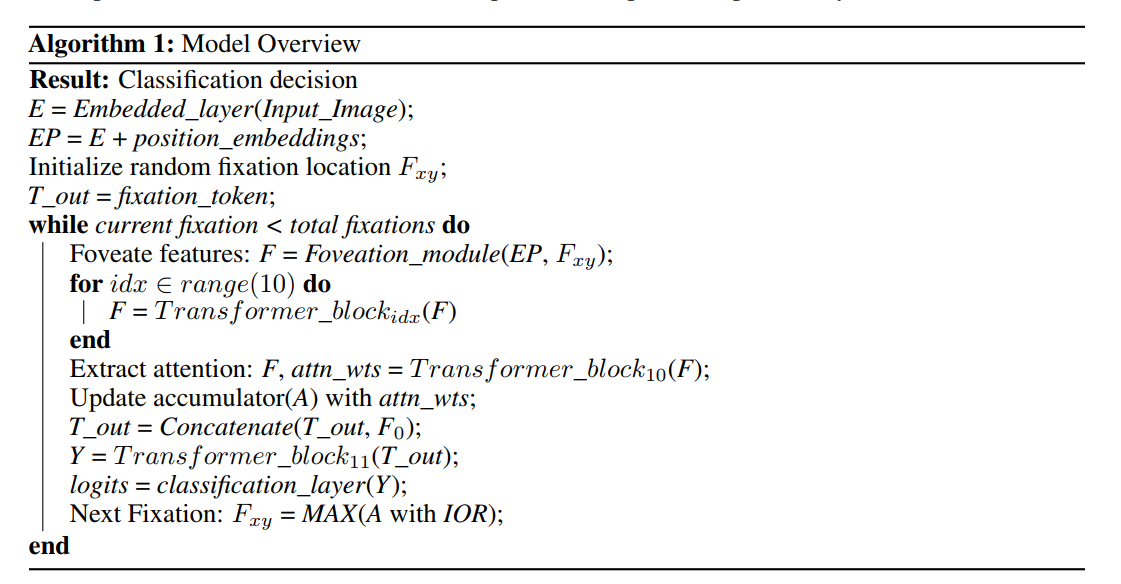

许多动物和人类以不同的空间分辨率(foveated vision)处理视野,并使用外围处理使眼球运动并指向中心凹以获取有关感兴趣对象的高分辨率信息。这种架构导致计算效率高的快速场景探索。视觉Transformer的最新进展为传统上依赖卷积的计算机视觉系统带来了新的替代方案。然而,这些模型没有明确地模拟视觉系统的注视点属性,也没有对眼球运动和分类任务之间的相互作用进行建模。我们提出了 foveated Transformer (FoveaTer) 模型,该模型使用池化区域和扫视运动来使用视觉 Transformer 架构执行物体分类任务。我们提出的模型使用平方池化区域来池化图像特征,这是对受生物启发的注视架构的近似,并将池化特征用作 Transformer 网络的输入。它根据 Transformer 分配给先前和当前注视的各个位置的注意力来决定接下来的注视位置。该模型使用置信阈值来停止场景探索,从而允许为更具挑战性的图像动态分配更多的注视/计算资源。我们使用我们提出的模型和 unfoveated 模型构建了一个集成模型,实现了比 unfoveated 模型低 1.36% 的精度,同时节省了 22% 的计算量。最后,我们证明了我们的模型对对抗性攻击的鲁棒性,它优于 unfoveated 模型。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢