标题:Technion、巴宜兰大学、艾伦人工智能研究所|Thinking Like Transformers(像变换器一样思考:变换器作为编程语言)

简介:变换器背后的计算模型是什么?循环神经网络有哪些地方有限状态机中的直接平行,允许围绕架构变体或训练模型、变换器进行清晰的讨论和思考没有这样熟悉的平行线。在本文中我们旨在改变这一点,提出一个计算形式为变换器编码器的模型一种编程语言。我们映射基本变换器编码器的组件——注意和前馈计算——转化为简单的原语,我们围绕这些原语形成了一种编程语言:受限访问序列处理语言 (RASP)。我们展示了 RASP 如何用于为可能的任务编写解决方案可以想象,由变换器学习,以及如何可以训练变换器来模拟 RASP 解决方案。特别是,我们提供 RASP 程序用于直方图、排序和 Dyck 语言。我们进一步使用我们的模型来关联他们在所需层数和注意力头的数量:分析 RASP 程序意味着所需的最大头数和层数在转换器中编码任务。最后,我们看到从我们的抽象中获得的洞察力可能如何用于解释最近作品中出现的现象。

论文下载:https://arxiv.org/pdf/2106.06981v1.pdf

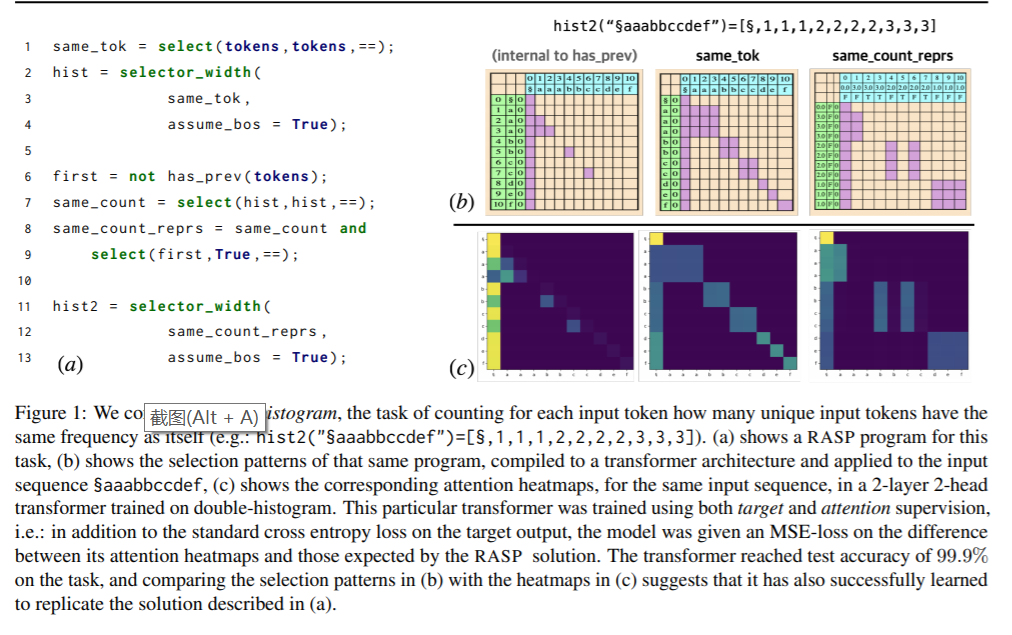

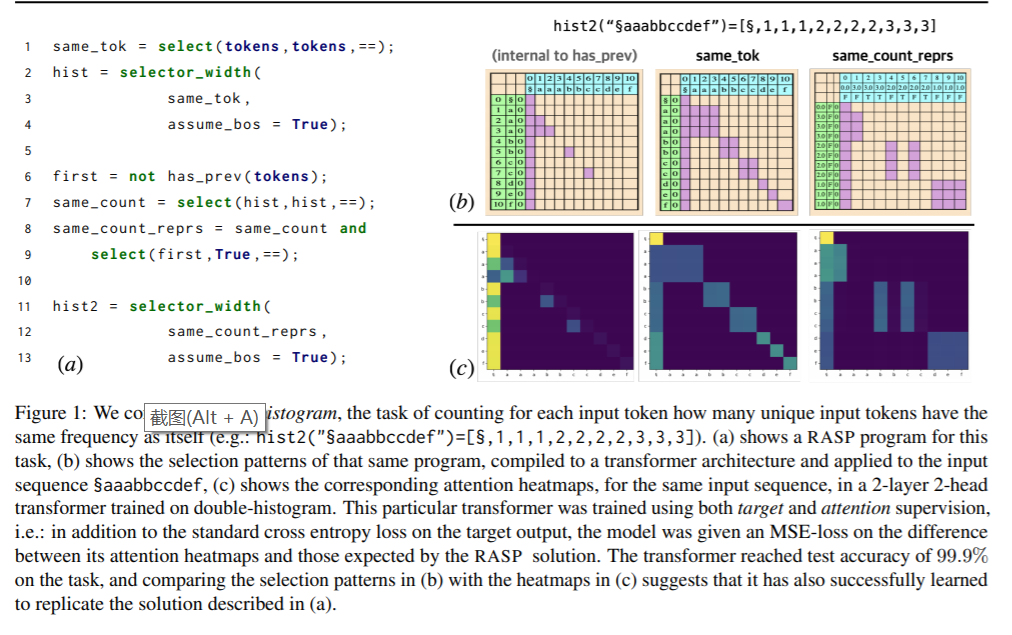

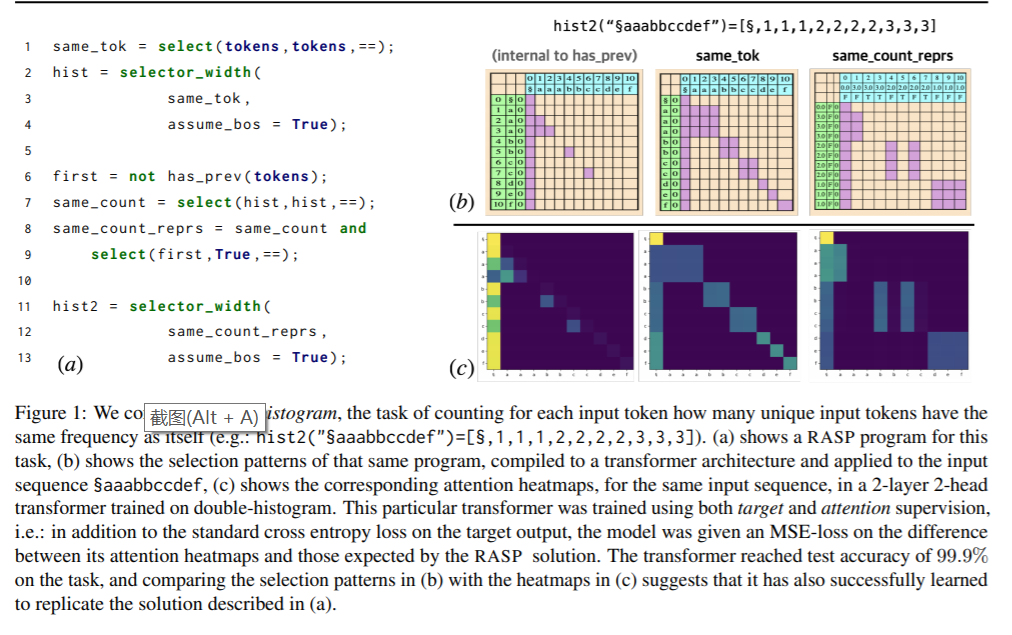

图1

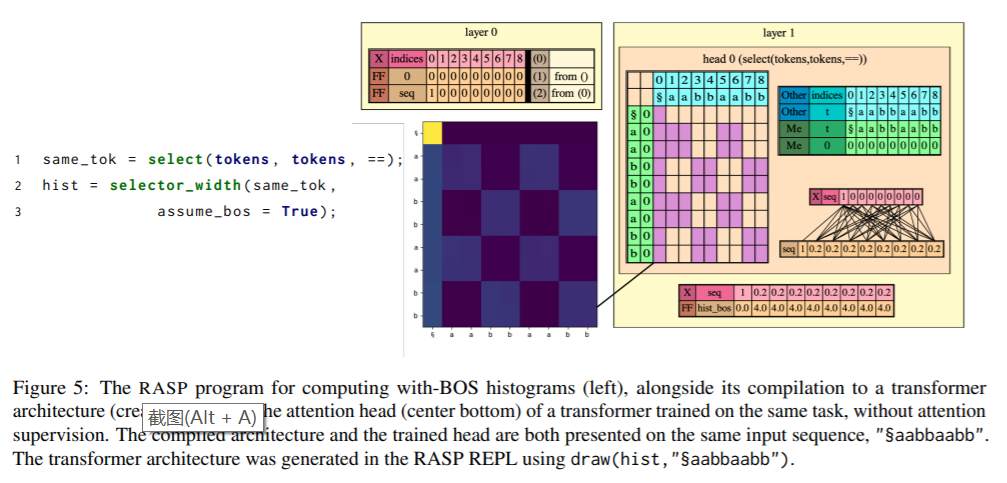

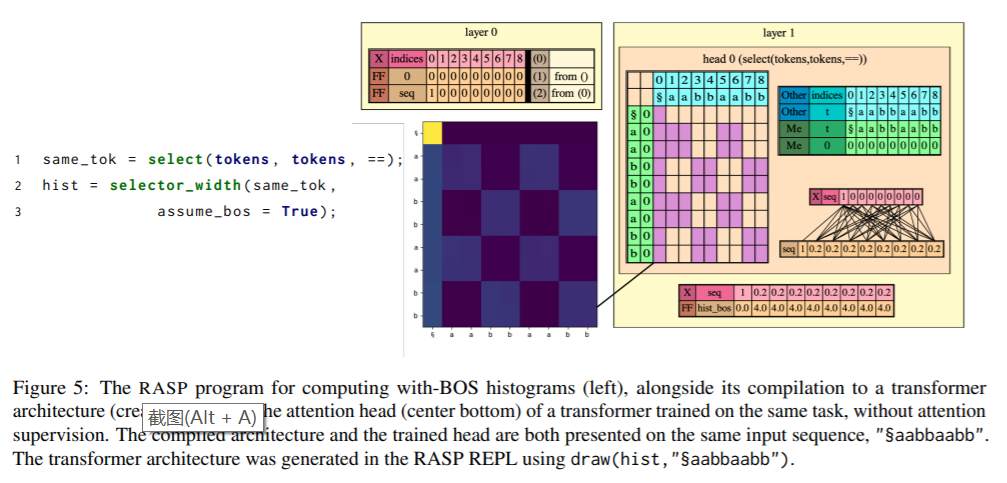

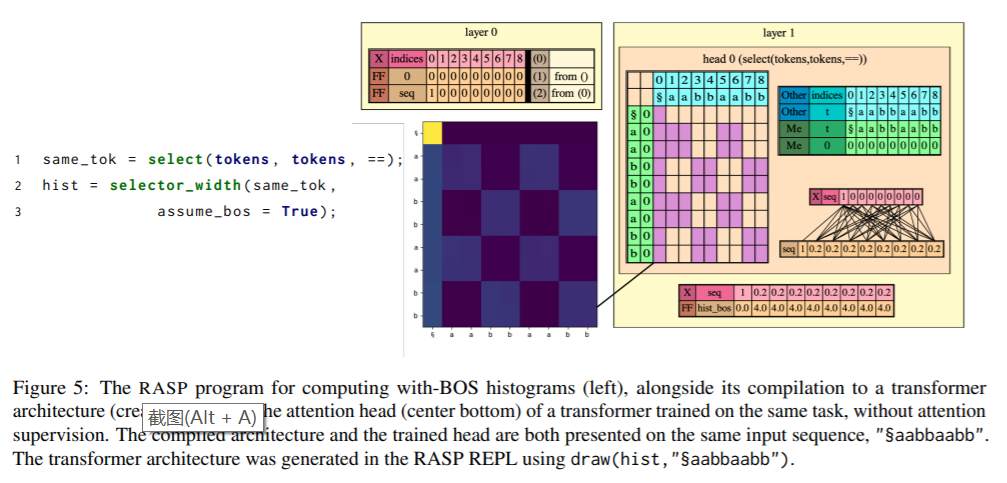

图2

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢