论文标题:UTNet: A Hybrid Transformer Architecture for Medical Image Segmentation

论文链接:https://arxiv.org/abs/2107.00781

作者单位:罗格斯大学

表现SOTA!性能优于ResUNet等网络。

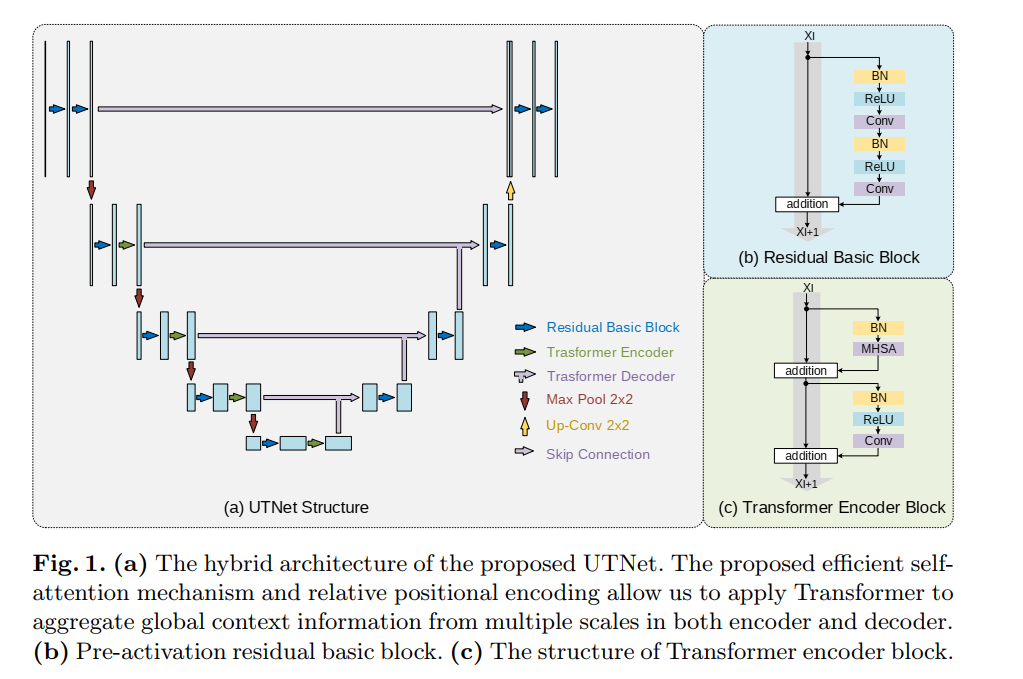

Transformer 架构已经在许多自然语言处理任务中取得成功。然而,它在医学视觉中的应用在很大程度上仍未得到探索。在这项研究中,我们提出了 UTNet,这是一种简单而强大的混合 Transformer 架构,它将自注意力集成到卷积神经网络中,以增强医学图像分割。UTNet 在编码器和解码器中应用自注意力模块,以最小的开销捕获不同规模的远程依赖。为此,我们提出了一种有效的自注意力机制以及相对位置编码,将自注意力操作的复杂性从 O(n2) 显著降低到近似 O(n)。还提出了一种新的自注意力解码器,以从编码器中跳过的连接中恢复细粒度的细节。我们的方法解决了 Transformer 需要大量数据来学习视觉归纳偏差的困境。我们的混合层设计允许在不需要预训练的情况下将 Transformer 初始化为卷积网络。我们已经在多标签、多供应商心脏磁共振成像队列上评估了 UTNet。 UTNet 展示了对最先进方法的卓越分割性能和鲁棒性,有望在其他医学图像分割上很好地泛化。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢