近日,百度 ERNIE 升级到 3.0,重磅发布知识增强的百亿参数大模型。该模型除了从海量文本数据中学习词汇、结构、语义等知识外,还从大规模知识图谱中学习。

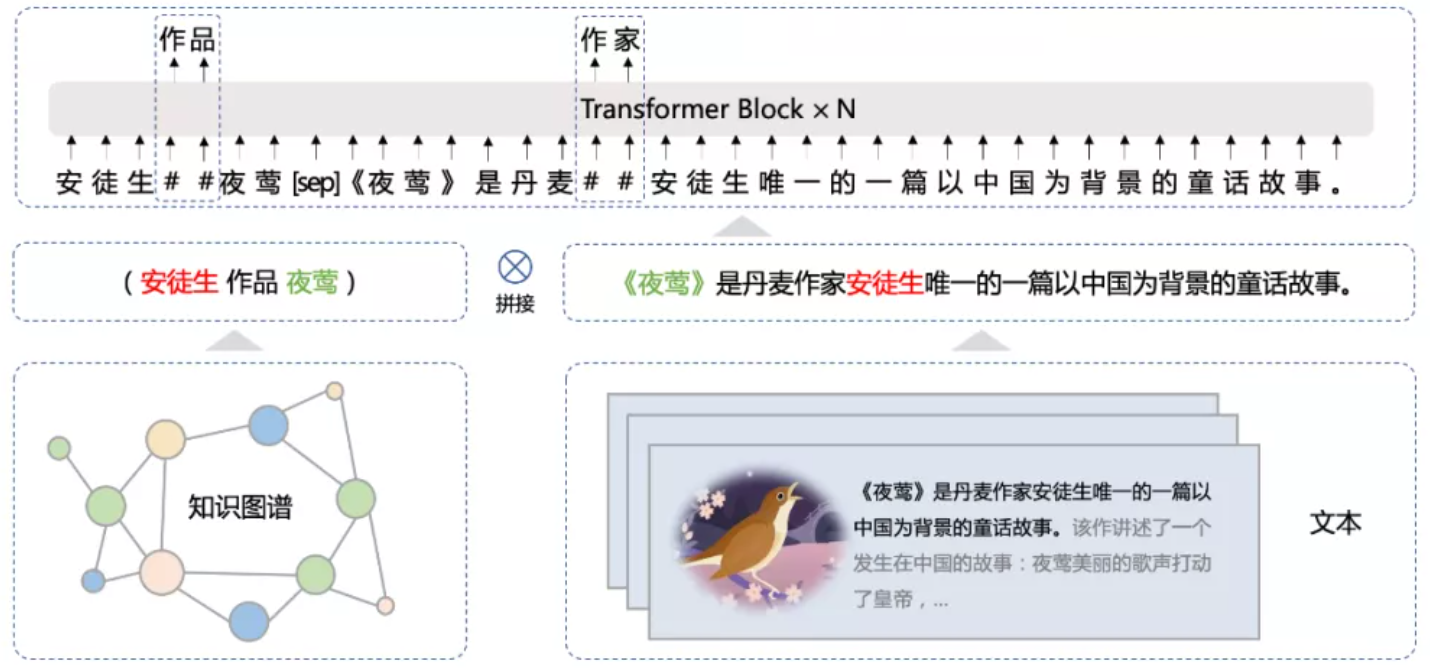

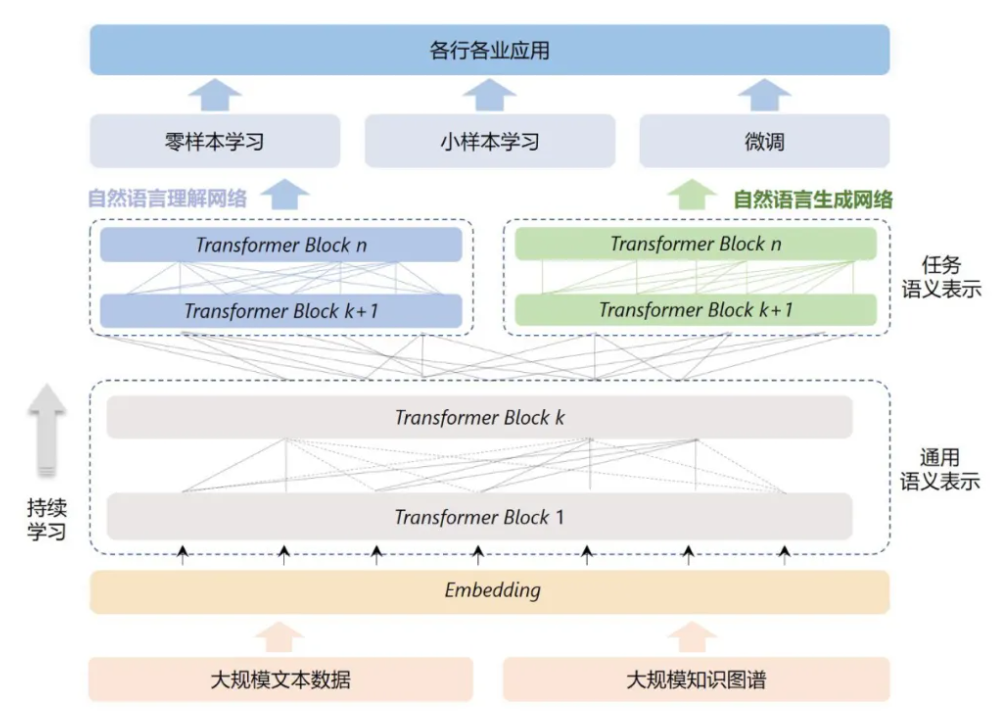

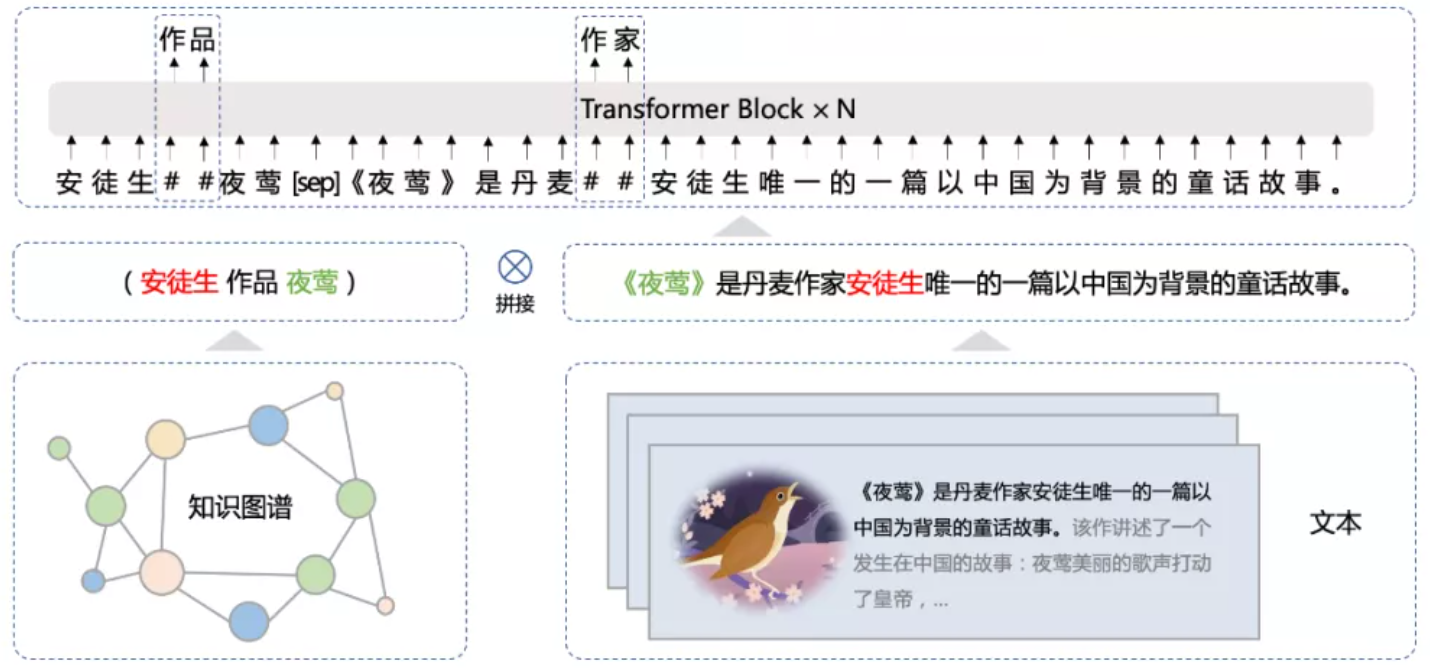

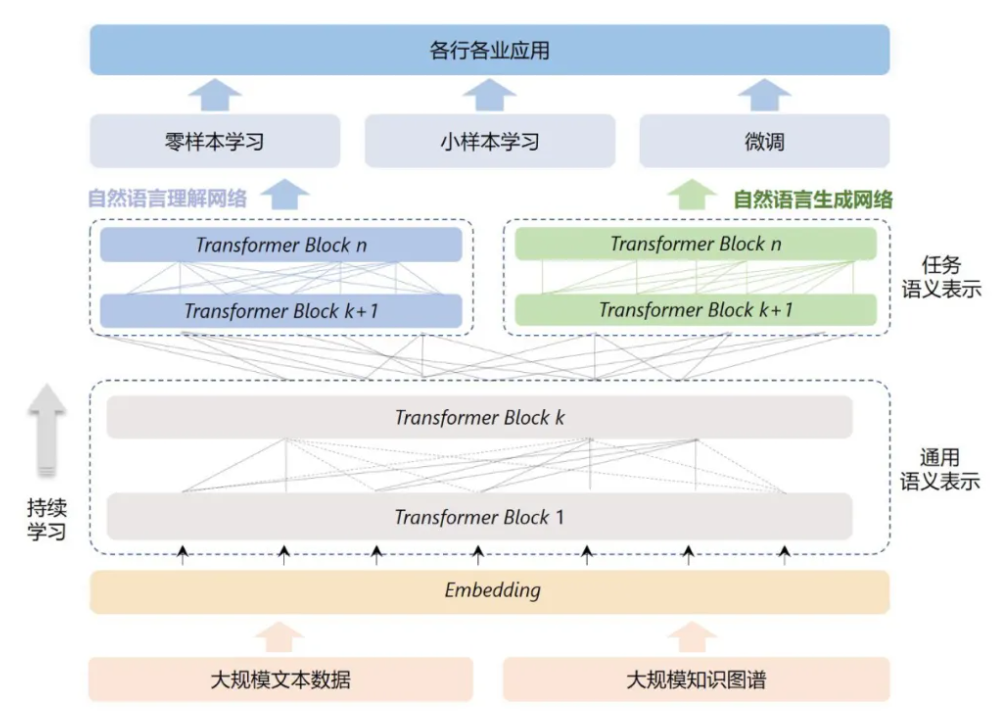

ERNIE 3.0 的研究者首次在百亿级预训练模型中引入大规模知识图谱,提出了海量无监督文本与大规模知识图谱的平行预训练方法(Universal Knowledge-Text Prediction)。通过将大规模知识图谱的实体关系与大规模文本数据同时输入到预训练模型中进行联合掩码训练,促进了结构化知识和无结构文本之间的信息共享,大幅提升了模型对于知识的记忆和推理能力。

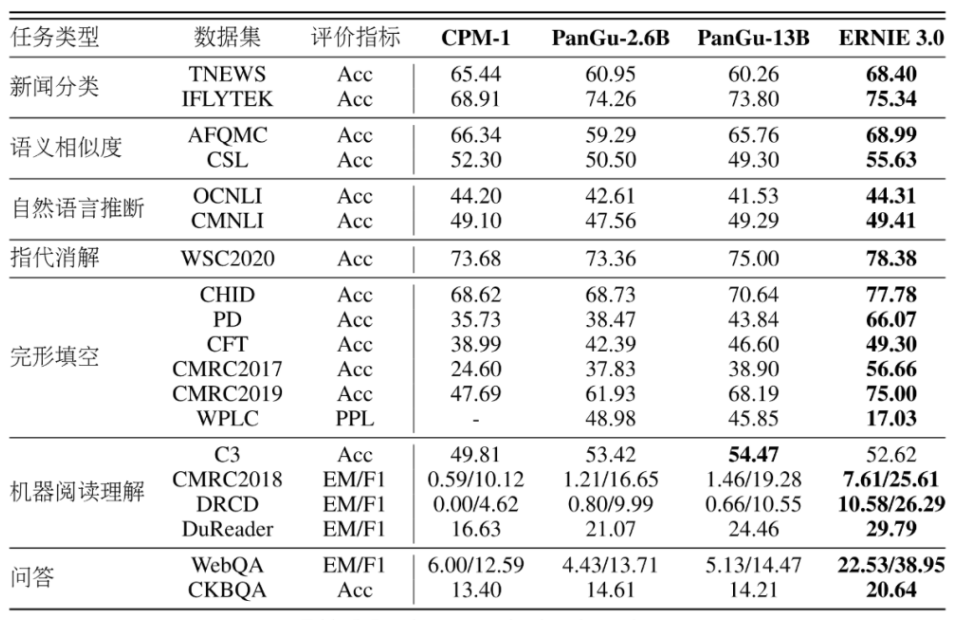

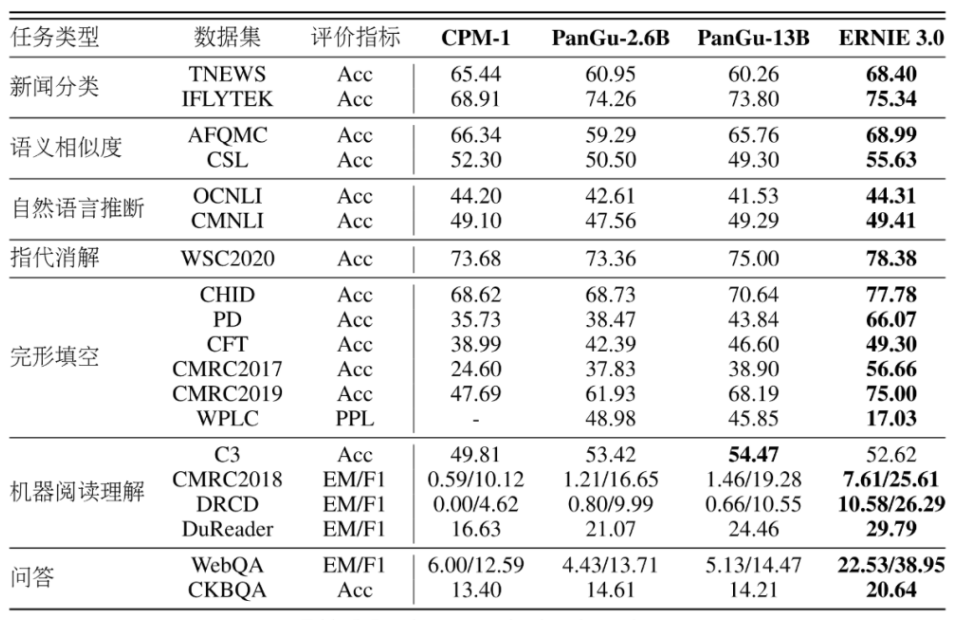

ERNIE 3.0 一举刷新 54 个中文 NLP 任务基准,其英文模型在国际权威的复杂语言理解任务评测 SuperGLUE 上,以超越人类水平 0.8 个百分点的成绩登顶全球榜首。ERNIE 3.0 同时具备超强语言理解能力以及写小说、歌词、诗歌、对联等文学创作能力。

实际应用中往往缺乏标注数据,因此,百度研究者也测试了 ERNIE 3.0 在 Zero-shot Learning(零样本学习)范式下的效果,ERNIE 3.0 在大多数任务上相对已有的中文大模型也取得了显著的效果提升。

目前 ERNIE 3.0 已在百度文心官网开放,用户可体验 ERNIE 3.0 创作的不同形式的内容,实现更多有创意、有价值的应用。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢