论文标题:A Unified Efficient Pyramid Transformer for Semantic Segmentation

论文链接:https://arxiv.org/abs/2107.14209

作者单位:复旦大学 & 亚马逊

一个统一的框架来解决语义分割问题,同时考虑上下文建模和边界细化,性能优于SETR、OCRNet等网络,代码即将开源!

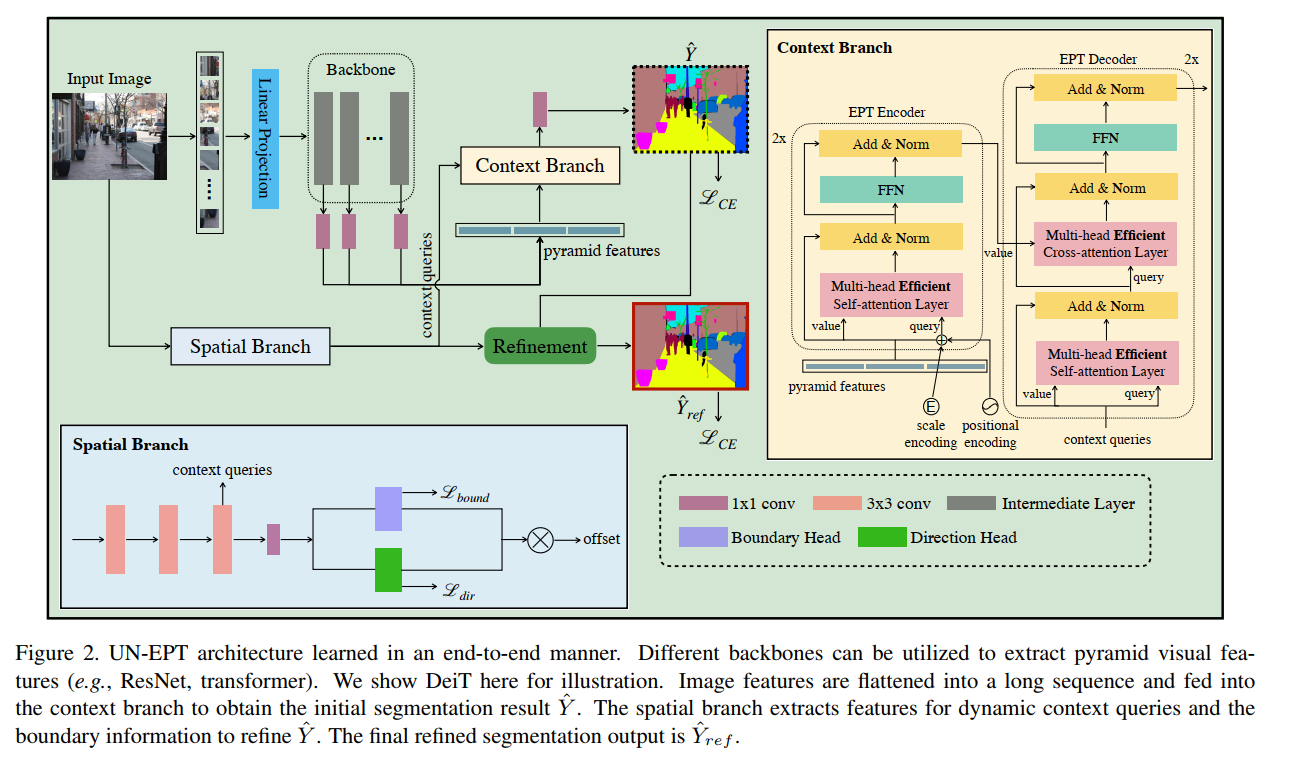

由于在复杂场景中建模上下文的困难和边界上的类混淆,语义分割是一个具有挑战性的问题。 大多数文献要么关注上下文建模,要么关注边界细化,这在开放世界场景中不太通用。 在这项工作中,我们提倡一个统一的框架(UN-EPT)通过考虑上下文信息和boundary artifacts来分割对象。 我们首先采用稀疏采样策略来整合基于Transformer的注意力机制,以实现高效的上下文建模。 此外,引入了一个单独的空间分支来捕获图像细节以进行边界细化。 整个模型可以以端到端的方式进行训练。 我们在三个流行的low memory footprint 语义分割基准上展示了有希望的性能。 代码将很快发布。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢