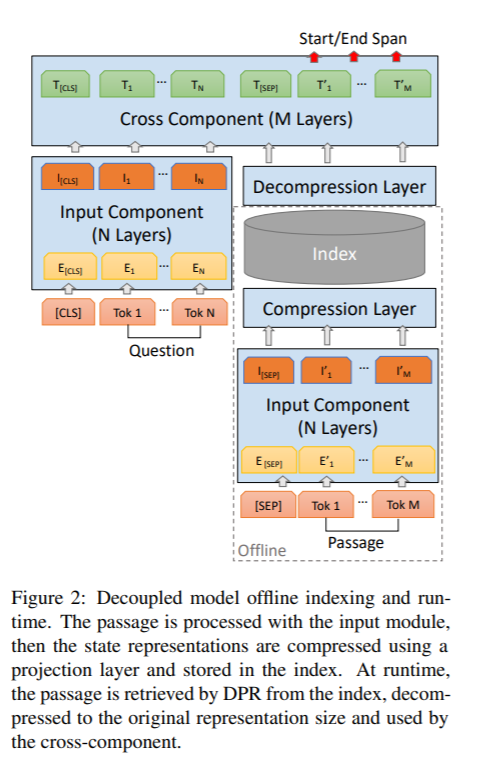

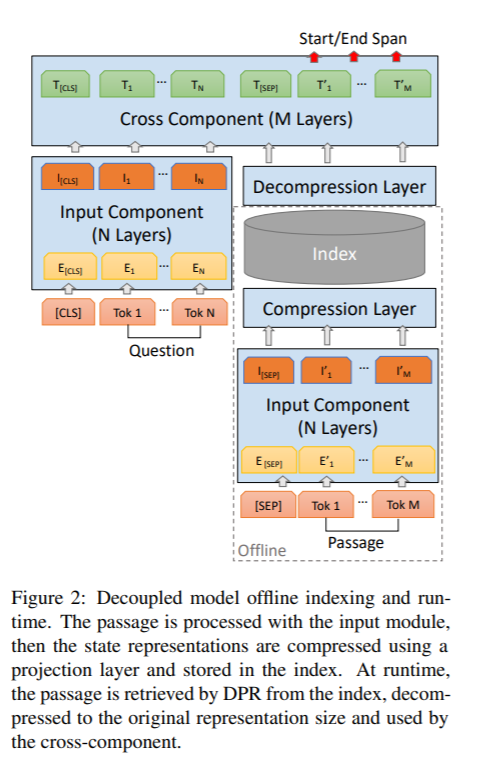

标题:脸书|Decoupled Transformer for Scalable Inference in Open-domain Question Answering(基于可扩展推理的解耦变换器的开放域问答)

https://arxiv-download.xixiaoyao.cn/pdf/2108.02765.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

https://arxiv-download.xixiaoyao.cn/pdf/2108.02765.pdf

内容中包含的图片若涉及版权问题,请及时与我们联系删除

沙发等你来抢

评论

沙发等你来抢