对于科技行业而言,科技伦理已是“必选项”和“必答题”。科技伦理被写入了十九届四中全会《决定》和《十四五规划和2035年远景目标纲要》,上升到了国家顶层政策设计。在监管层面,互联网监管聚焦人工智能算法应用,算法滥用、算法推荐的治理被提上日程,《数据安全法》要求数据活动和数据新技术应当“符合社会公德和伦理”。

科技伦理是科技活动必须遵守的价值准则,科技公司需要践行科技伦理。今年5月,在旷视科技IPO过程中,上交所首次对科技伦理进行了问询,要求旷视披露公司在人工智能伦理方面的组织架构、核心原则、内部控制及执行情况。今年7月28日,科技部发布《关于加强科技伦理治理的指导意见(征求意见稿)》,明确了伦理先行、敏捷治理等基本要求,并提出了五项科技伦理原则,同时要求企业根据实际情况建立科技伦理(审查)委员会,并要求“从事生命科学、医学、人工智能等科技活动的机构,研究内容涉及科技伦理敏感领域的,应设立科技伦理(审查)委员会”,此外还要求对科技人员加强科技伦理培训。《深圳经济特区人工智能产业促进条例(草案)》要求人工智能企业“设立伦理风险岗位”,“履行伦理审查和风险评估职责”。

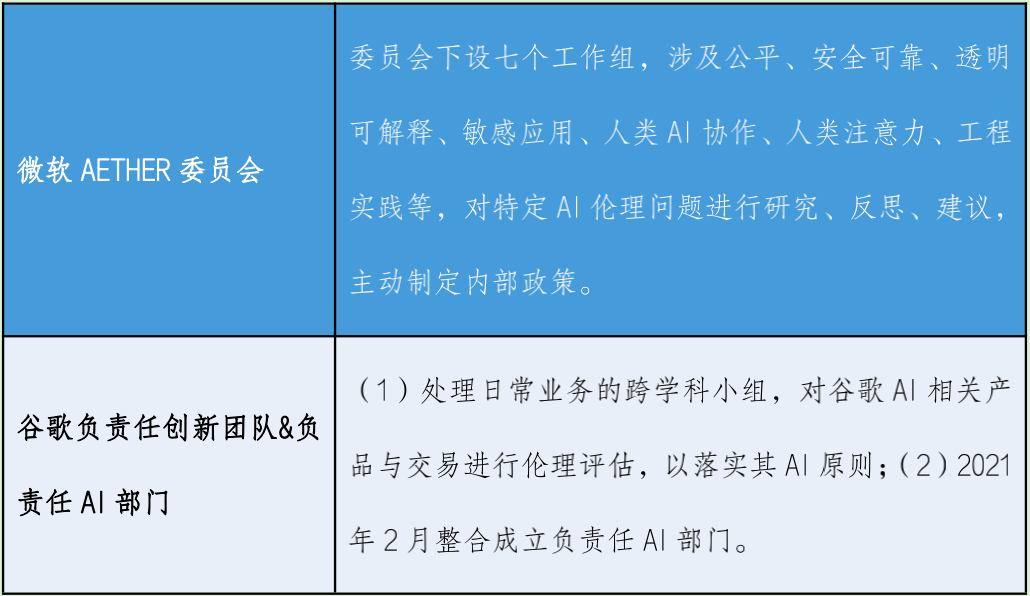

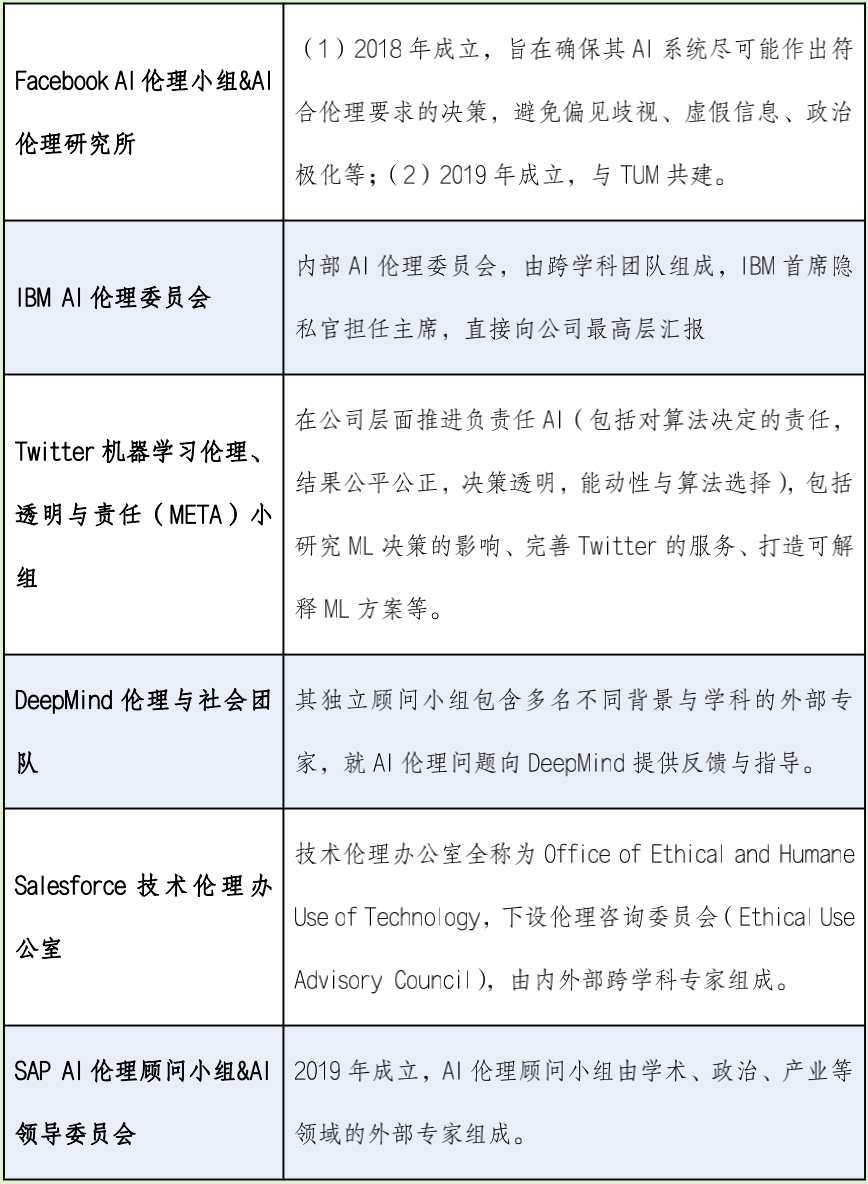

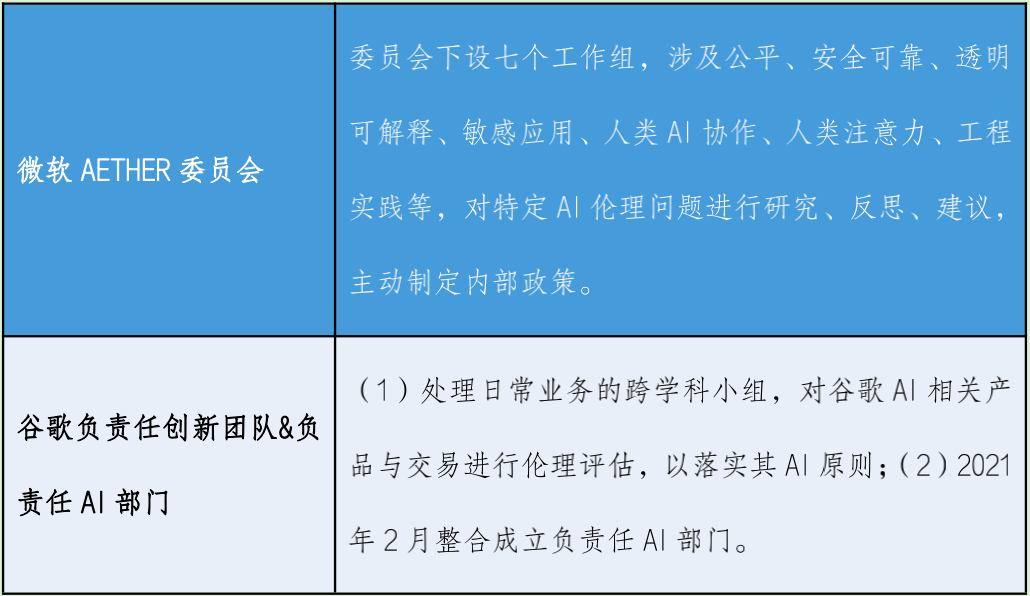

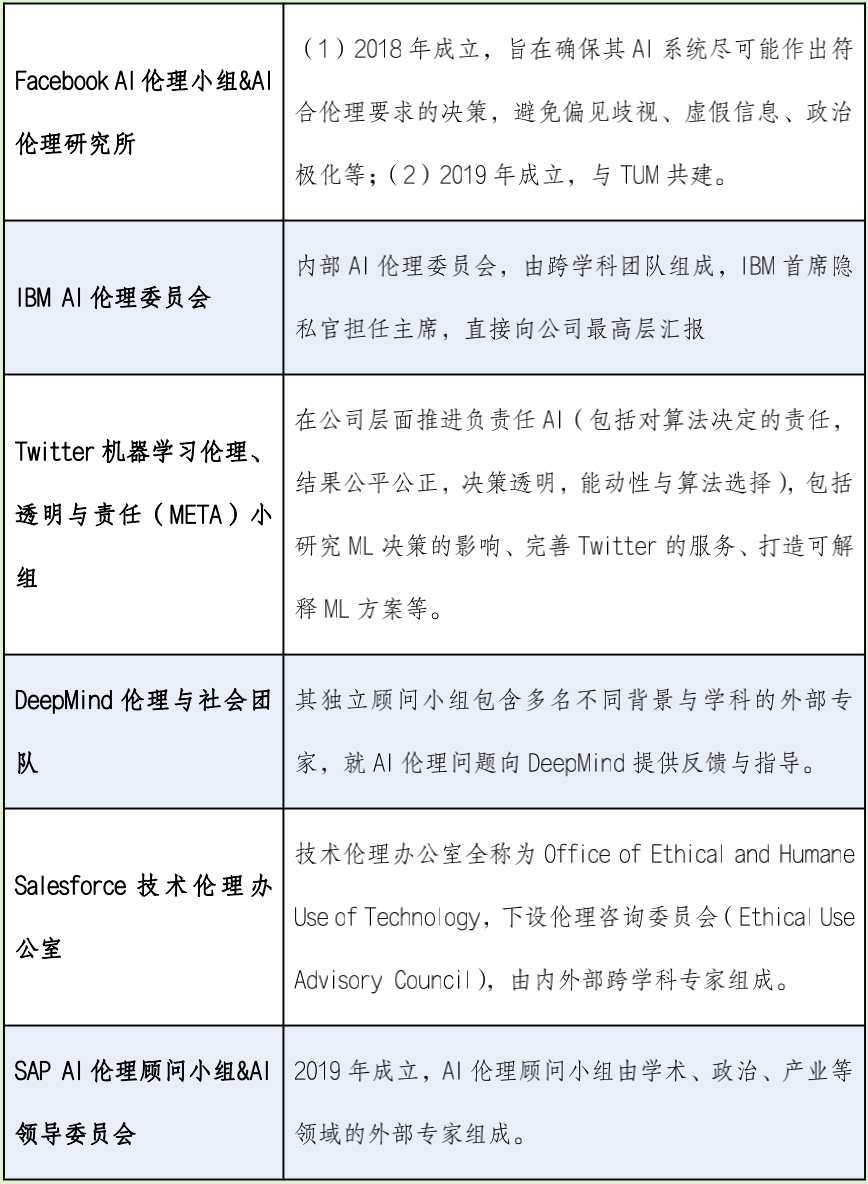

可信的(trustworthy)、负责任的(responsible)、以人为本(human-centric)的人工智能已是AI领域的主旋律。然而,过去几年这一领域的主要进展停留在提出、建立AI伦理原则及相关框架,较少关注如何将这些原则转化为AI领域的技术实践。据不完全统计,全球关于人工智能原则的文件超过百份。将伦理原则付诸实践才能产生现实的价值。当前,各界已在探索将伦理原则翻译为实践的机制、做法、工具等,让人工智能原则操作化、落地化,真正融入、嵌入人工智能研发流程与业务应用。这些机制包括伦理审查委员会、伦理标准与认证、关于算法透明和伦理检查的最佳实践做法、技术工具等等,大都处于前期的摸索阶段。但这些实践具有一定的局限性,受限于成本、效率等因素,难以对AI领域产生规模化影响。借鉴互联网领域中的SaaS概念,以伦理工具方式展现的伦理即服务(ethics as a service)这一全新的理念开始得到重视,推动AI伦理产业化发展,让可信AI的普惠化成为可能。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢