论文标题:Boosting Salient Object Detection with Transformer-based Asymmetric Bilateral U-Net

论文链接:https://arxiv.org/abs/2108.07851

作者单位:南开大学 & 苏黎世联邦理工学院 & 电子科大

本文提出了一种基于Transformer的非对称双边 U-Net:AbiU-Net,来学习互补的全局和局部表示,在SOD任务上表现SOTA!性能优于GateNet、GCPANet等网络,代码将开源!

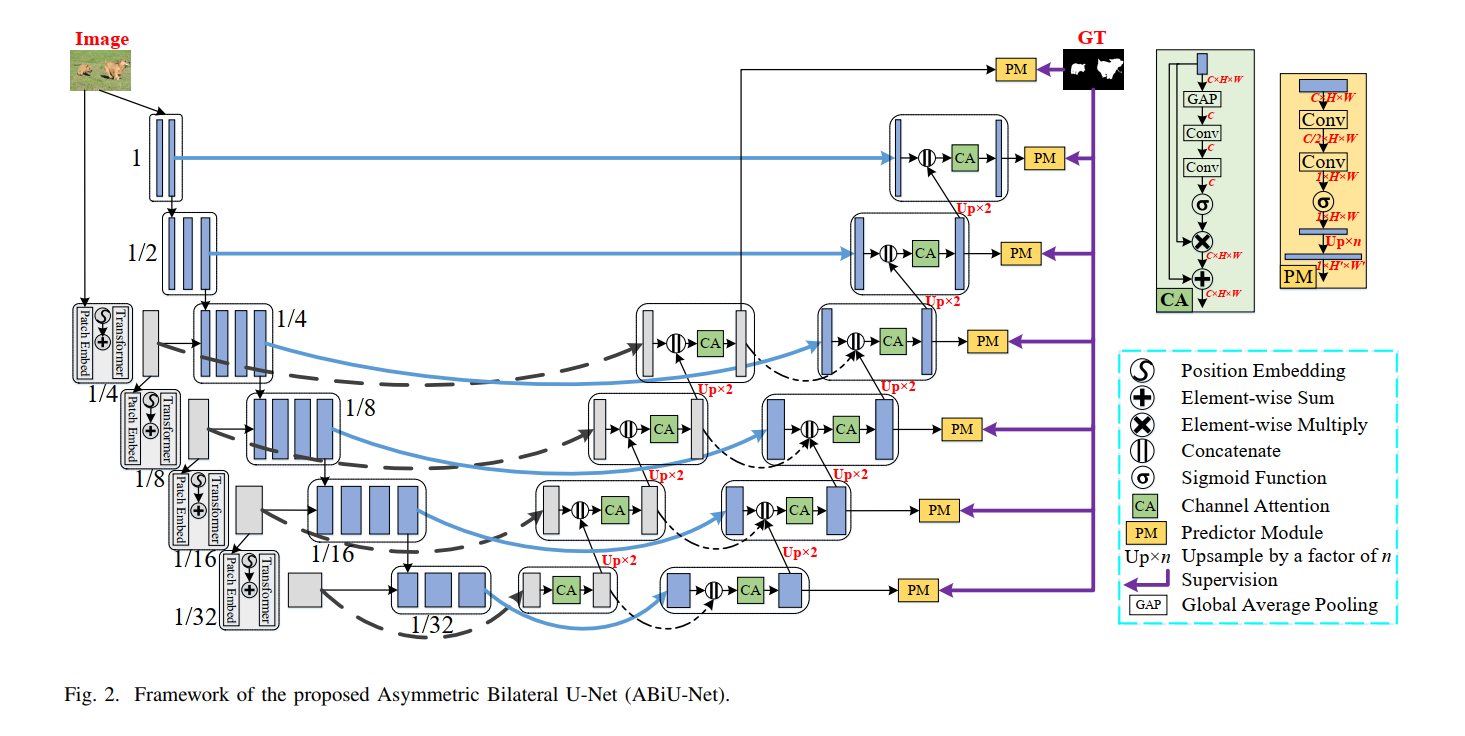

现有的显著性目标检测 (SOD) 模型主要依靠基于 CNN 的 U 形结构与跳跃连接来结合全局上下文和局部空间细节,这分别对定位显著性对象和细化对象细节至关重要。尽管取得了巨大的成功,但 CNN 在学习全局背景方面的能力是有限的。最近,由于其强大的全局依赖性建模,视觉Transformer在计算机视觉领域取得了革命性的进步。然而,直接将Transformer应用于 SOD 显然是次优的,因为Transformer缺乏学习局部空间表示的能力。为此,本文探索了 Transformer 和 CNN 的结合,以学习 SOD 的全局和局部表示。我们提出了一种基于Transformer的非对称双边 U-Net (AbiU-Net)。非对称双边编码器有一个Transformer路径和一个轻量级的 CNN 路径,其中两条路径在每个编码器阶段进行通信,以分别学习互补的全局上下文和局部空间细节。非对称双边解码器还包含两条路径来处理来自Transformer和 CNN 编码器路径的特征,在每个解码器阶段进行通信,分别用于解码粗略的显著性对象位置和查找粒度对象细节。两个编码器/解码器路径之间的这种通信使 AbiU-Net 能够分别利用 Transformer 和 CNN 的自然属性来学习互补的全局和局部表示。因此,ABiU-Net 为基于Transformer的 SOD 提供了一个新的视角。大量实验表明,ABiU-Net 与之前最先进的 SOD 方法相比表现出色。代码将被发布。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢