【标题】PatchMatch-RL: Deep MVS with Pixelwise Depth, Normal, and Visibility

【作者】Jae Yong Lee, Joseph DeGol, Chuhang Zou, Derek Hoiem

【论文链接】https://arxiv.org/pdf/2108.08943.pdf

【发表日期】2021.8.19

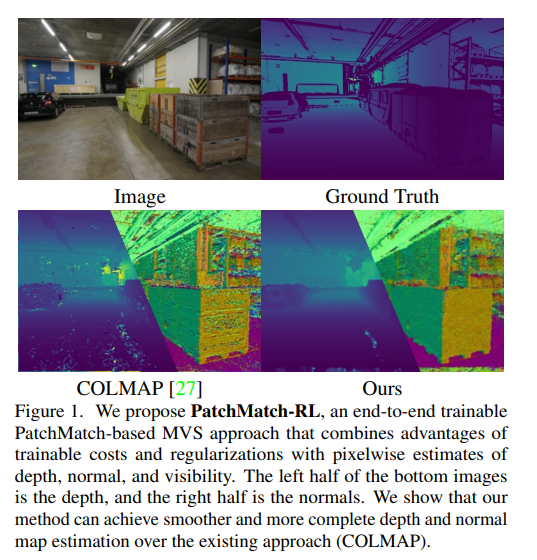

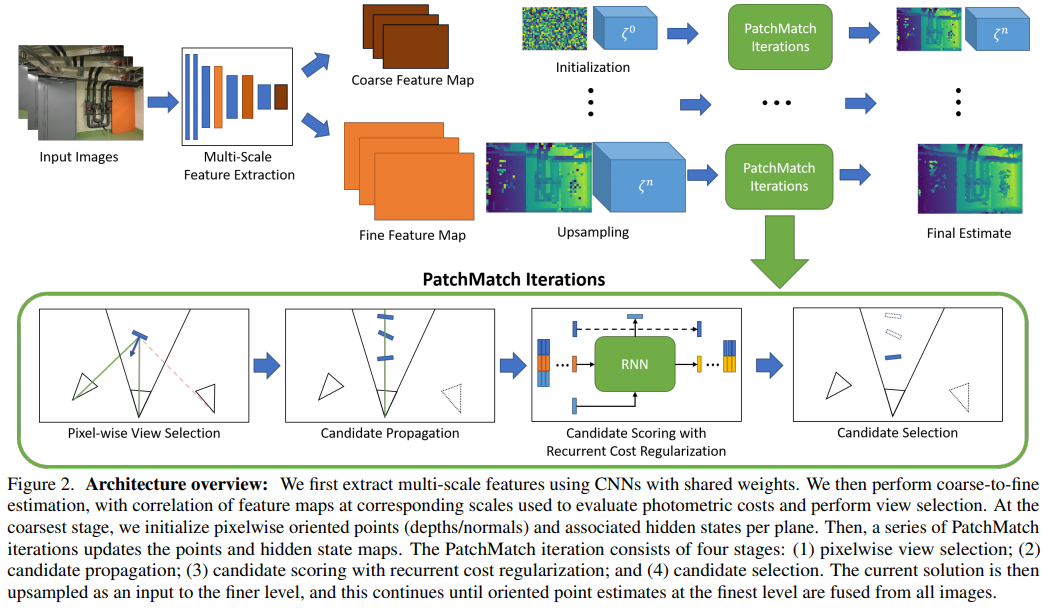

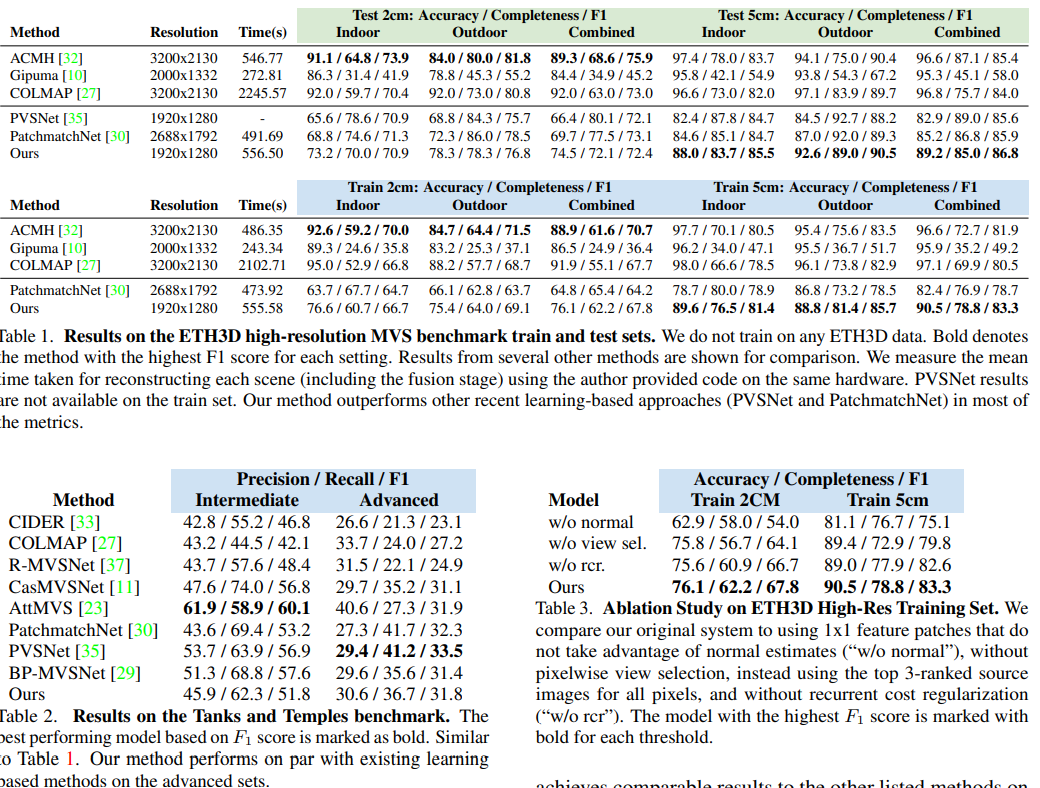

【推荐理由】最近基于学习的多视图立体 (MVS) 方法在密集相机和小深度范围内表现出优异的性能。然而,基于非学习的方法仍然优于具有大深度范围和稀疏宽基线视图的场景,部分原因是它们对深度、法线和可见性的像素级估计进行了 PatchMatch 优化。本文提出了一种端到端可训练的基于 PatchMatch 的 MVS 方法,它将可训练成本和正则化的优势与像素估计相结合。为了克服涉及迭代采样和硬决策的不可微 PatchMatch 优化的挑战,本文使用强化学习以最小化预期的光度成本并最大化真实深度和法线的可能性。通过使用扩张的补丁内核来合并法线估计,并提出了一种循环成本正则化,该正则化适用于本文的像素深度/法线估计之外的正面平面扫描算法。通过广泛使用的MVS 基准、ETH3D 和 Tanks and Temples (TnT) 上评估该方法,并与其他最先进的基于学习的 MVS 模型进行比较。在 ETH3D 上,该方法优于其他最近的基于学习的方法,并且在先进的 TnT 上性能相当。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢