论文标题: Self Supervision to Distillation for Long-Tailed Visual Recognition

论文链接:https://arxiv.org/abs/2109.04075

作者单位:南京大学

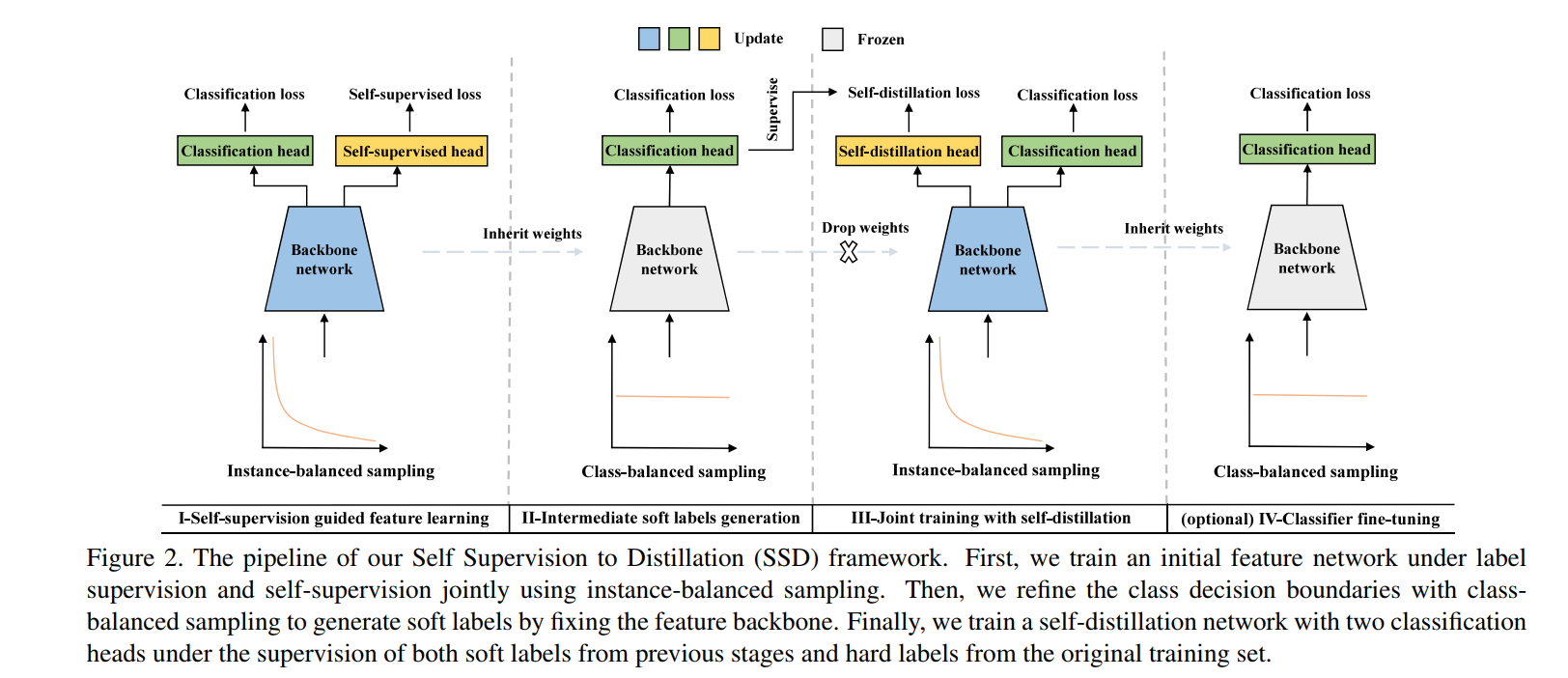

深度学习在大规模平衡数据集的视觉识别方面取得了显着进展,但在现实世界的长尾数据上仍然表现不佳。 以前的方法通常采用类重新平衡训练策略来有效缓解不平衡问题,但可能存在过度拟合尾类的风险。 最近的解耦方法通过使用多阶段训练方案克服了过拟合问题,但仍然无法在特征学习阶段捕获尾类信息。 在本文中,我们展示了软标签可以作为一种强大的解决方案,将标签相关性纳入多阶段训练方案以进行长尾识别。 软标签所体现的类之间的内在关系通过将知识从头到尾类转移,从而有助于长尾识别。

具体来说,我们提出了一个概念上简单但特别有效的多阶段训练方案,称为自监督蒸馏(SSD)。 该方案由两部分组成。 首先,我们引入了一个用于长尾识别的自蒸馏框架,它可以自动挖掘标签关系。 其次,我们提出了一种由自我监督引导的新蒸馏标签生成模块。 蒸馏标签整合了来自标签和数据域的信息,可以有效地对长尾分布进行建模。 我们进行了广泛的实验,我们的方法在三个长尾识别基准上取得了最先进的结果:ImageNet-LT、CIFAR100-LT 和 iNaturalist 2018。我们的 SSD 比强大的 LWS 基准高 2.7% 到 4.5% 在各种数据集上。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢