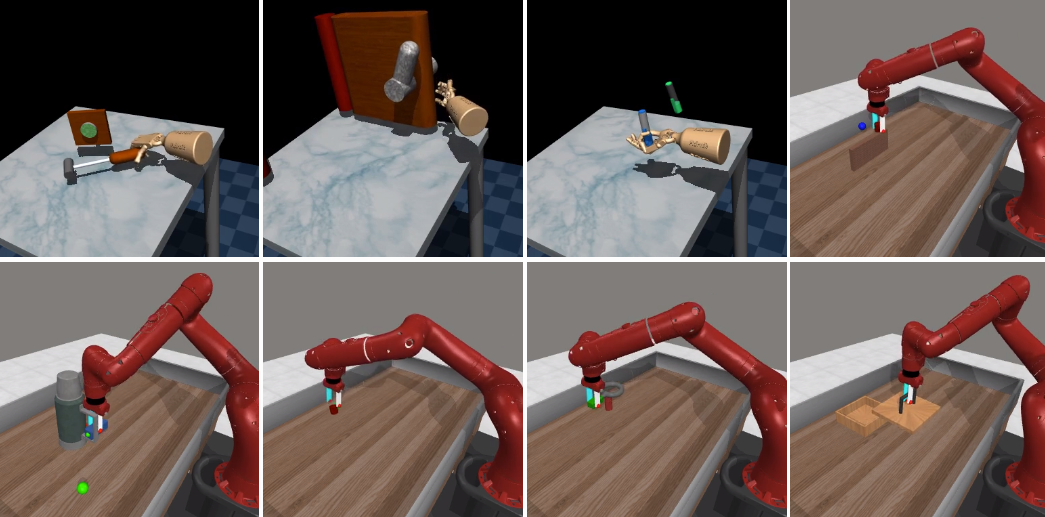

MetaAI 近日发布MoDem,它解决了视觉强化学习领域的三个挑战,无需解码器,效率最高提升250%。

只需给出5个演示,MoDem就能在100K交互步骤中解决具有稀疏奖励和高维动作空间的具有挑战性的视觉运动控制任务,大大优于现有的最先进方法。

MetaAI 负责视觉和强化学习领域,MoDem作者Aravind Rajeswaran发布此消息后,Lecun也转发了这一研究,表示MoDem的模型架构类似于JEPA,可在表征空间做出预测且无需解码器。

样本效率低下是实际应用部署深度强化学习 (RL) 算法的主要挑战,尤其是视觉运动控制。基于模型的RL有可能通过同时学习世界模型并使用合成部署来进行规划和政策改进,从而实现高样本效率。然而在实践中,基于模型的RL的样本高效学习受到探索挑战的瓶颈,这次研究恰恰解决了这些主要挑战。

论文链接:https://arxiv.org/abs/2212.05698

Github链接:https://github.com/facebookresearch/modem

MoDem分别通过使用世界模型、模仿+RL和自监督视觉预训练,解决了视觉强化学习/控制领域的三个主要挑战:

-

大样本复杂性(Large sample complexity)

-

高维状态和动作空间探索(Exploration in high-dimensional state and action space)

-

同步视觉表征和行为学习(Simultaneous learning of visual representations and behaviors)

参考资料

https://nicklashansen.github.io/modemrl/

https://twitter.com/aravindr93/status/1607483342580244480

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢